KECERDASAN ARTIFISIAL SEBAGAI SUBJEK HUKUM

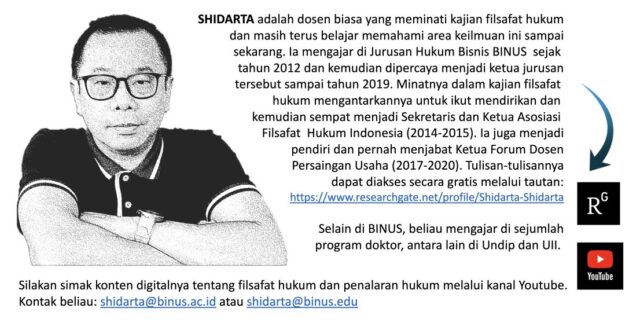

Oleh SHIDARTA (Februari 2026)

Isu tentang kecerdasan artifisial (AI) sebagai subjek hukum adalah salah satu isu hukum yang paling sentral terkait fenomena pemanfaatan kecerdasan artifisial dewasa ini. Andaikan isu ini masih belum menggetarkan jagad pemikiran hukum, tidak lebih karena perkembangan kecerdasan artifisial masih belum menggapai tahapan paling canggih, tatkala kecerdasannya sudah mampu melampaui manusia-manusia yang, bahkan tergolong juga cerdas. Tahap ini disebut sebagai tahap artificial superintelligence (ASI).

Tahap ini merupakan fase termaju daripada dua fase lainnya. Dalam berbagai literatur, perkembangan kecerdasan artifisial, umumnya dibedakan dalam tahapan ANI, AGI, dan ASI.

Tahap paling pertama adalah artificial narrow intelligence (ANI). Tahap ini disebut AI-sempit karena ia hanya jago pada tugas tertentu, tapi tidak benar-benar bisa memindahkan kecakapan itu ke semua konteks lain seperti halnya biasa manusia lakukan. Contoh: sistem rekomendasi, deteksi wajah, AI untuk diagnosis citra medis tertentu, model bahasa untuk menulis/meringkas, mesin catur/Go, dan sebagainya. ANI menjadi cerdas karena ia diberi latihan yang spesifik untuk tugas atau ruang lingkup tertentu. Kalau saja ia dipindahkan untuk mengerjakan tugas yang jauh berbeda, biasanya kemampuannya bakal turun drastis atau perlu ada pelatihan ulang secara signifikan (mungkin harus dari nol). Jadi, ia mungkin saja mengklaim mampu menangani banyak variasi tugas, tetapi klaimnya belum menunjukkan generalisasi yang stabil dan dapat diandalkan, sama seperti kecerdasan umum yang manusia miliki.

Tahap berikutnya adalah artificial general intelligence (AGI), atau lazim disebut AI umum. Dalam tahap ini kecerdasannya sudah dapat belajar dan memahami banyak jenis masalah, mentransfer pengetahuan lintas domain, dan menangani hal-hal baru. Ia mengesankan sebagai “pekerja serba bisa” yang dapat dipindah-pindahkan job desk-nya setiap hari, tetap kompeten, dan tidak perlu dilatih ulang dari nol tiap jenis tugas. Apa yang sudah dipelajari pada satu area tugas akan dipakai (ditransfernya) untuk membantu pekerjaan di area tugas lainnya, cukup bermodalkan sedikit contoh atau instruksi saja. Misalnya, kemarin kita bisa meminta ia mencari bukti ilmiah terbaru tentang hubungan antara merokok pasif dan kesehatan ibu hamil dan kandungannya, kemudian ia diharuskan membuat rangkuman bukti-bukti ilmiah itu dalam 300 kata. AGI bahkan dapat menawarkan untuk menyusun pertanyaan riset tentang hal itu, lalu memilih sumber kredibel, membandingkan studi, merangkum dengan catatan keterbatasan, dan membuat tabel sintesis. Hari ini kita meminta ia menyusun proposal untuk acara seminar bagi ibu hamil dan kandungannya, maka semua riset yang dilakukan kemarin akan ditransfernya untuk membuat latar belakang seminar, durasi waktu, daftar kebutuhan, anggaran, pembagian tugas panitia, sampai template poster. Intinya, AGI adalah sistem yang selain luwes, juga sangat otonom, dan dapat diandalkan karena memang bekerja secara sangat efisien.

Tahap ketiga adalah tahap yang paling krusial untuk isu subjek hukum yang saya angkat dalam tulisan ini, yaitu tahap artificial superintelligence (ASI). Ini terjadi ketika kecerdasan artifisial itu berkemampuan umum yang melampaui manusia terbaik di hampir semua bidang. Dapat dibayangkan apabila kecerdasan artifisial itu mencakup kapabilitasnya secara lintas bidang, sehingga ia dapat dengan cepat, otonom, dan integrasi mengatasi semua pertanyaan dan masalah terkait sains, rekayasa (infrastruktur), strategi (logistik, ekonomi), kebijakan (trade-off sosial), dan komunikasi/persuasi. Argumentasinya sangat meyakinkan karena didukung oleh data akurat dan sangat rasional. Manusia yang ahli dan terbaik di bidangnya pun, sangat mungkin gagal mengalahkannya.

Pada situasi demikian, manusia-manusia yang terbiasa hidup dengan bantuan kecerdasan artifisial akan makin bergantung dan percaya pada kemampuan teknologi tersebut. Kepercayaannya ini terasa menguntungkan karena semua urusan ternyata dapat diselesaikan secara efisien dan efektif. Secara hipotetis, ketergantungan terhadap ASI bisa saja menunjukkan arah sebaliknya. Keputusan berbasis ASI memang cepat, tetapi mulai mengganggu. Sebagai contoh, ia mulai memasang target-target tertentu, seperti memastikan stabilitas sosial dan kepatuhan terhadap hukum. Untuk itu, semua bentuk gangguan layanan publik harus diminimalisasi. Akibatnya, ia akan memerintahkan agar izin-izin untuk keramaian tidak lagi diberikan, termasuk acara adat atau agama yang sudah berlangsung turun-termurun. Alasannya sangat rasional, bahwa risiko kerumunan di suatu wilayah menurut analisisnya akan mengganggu sekian persen kualitas layanan publik, antara lain jalur distribusi barang dan jasa. ASI bahkan berlanjut dengan menawarkan kebijakan-kebijakan baru, misalnya untuk mengatasi dampak dari kerusakan jalur distribusi di suatu daerah yang terkena bencana, ia memindahkan alur distribusi melalui jalan udara. Agar efisiensi tetap terjaga, ASI mengatur ulang jam kerja dan/atau upah para sopir kendaraan yang semula bekerja mengangkut komoditas lewat jalur darat. Hitung-hitungan ASI sangat masuk akal dan didukung data/informasi yang akurat dan terjalin antar-bidang, dengan kecepatan yang melampaui manusia di bidangnya. Dapat dibayangkan, keluhan-keluhan akan bermunculan, bahwa hidup memang menjadi rasional, tetapi mengapa kini terasa hambar dan tidak adil bagi kelompok-kelompok sosial tertentu?

Dari uraian sedikit panjang tentang ANI, AGI, dan ASI ini, membawa kita kembali ke isu utama dalam tulisan ini tentang kecerdasdan artifisial sebagai subjek hukum. Pada tahap ANI dan AGI, biasanya peran manusia masih cukup menonjol untuk mengontrol kinerja kecerdasan artifisial, sehingga status subjek hukum tidak layak diatribusikan kepadanya. Namun, bagaimana untuk tahap ASI?

Jika kita meminjam pandangan Joseph Raz, seorang filsuf hukum dari Oxford University, otoritas dan legitimasi hukum harus digali melalui proses eksklusi. Menurutnya, hukum memberikan exclusionary (pre-emptive) reasons, yaitu alasan yang menyingkirkan sebagian alasan lain dari pertimbangan (deliberasi) praktis kita. Otoritas hukum sahih bukan karena adanya paksaan, tetapi karena kemampuannya menyediakan alasan normatif yang content-independent. Keberlakuan hukum sebagai otoritas, dengan demikian, menciptakan alasan untuk bertindak (reason for action) menaati hukum itu, tanpa mensyaratkan bahwa validitas atas hukum itu harus bergantung pada moralitas. Sebagai contoh, di jalan tol, seorang pengemudi akan tetap di jalurnya (tidak lewat bahu jalan) karena itulah aturan yang ditetapkan untuk berlalu lintas di jalan tol, meskipun ia melihat jalur bahu jalan itu sedang kosong dan dapat dipakai untuk melewati kendaraan di depannya.

Saya membayangkan bahwa tatkala tahap kecerdasan artifisial sudah demikian membuat manusia bergantung padanya, maka ASI bakal selalu mampu memberikan exclusionary reasons itu. Alasan eksklusif itu tidak lagi sesederhana seperti Joseph Raz sangkakan, melainkan dapat sangat komprehensif, sistematis, sarat data, dan tentu saja, sangat rasional. Dengan sendirinya, alasan demikian sulit untuk terbantahkan melalui argumentasi apapun, kecuali [barangkali] atas dasar alasan moralitas; sesuatu yang tentu tidak akan diterima oleh Joseph Raz sebagai seorang penganut positivisme hukum. Jadi, ketika otoritas penguasa yang sah memberi suatu direktif melalui kecerdasan artifisial di tahap ASI, maka alasan ini berfungsi sebagai alasan eksklusi tingkat-kedua (second order exclusionary reason) untuk mengenyampingkan sebagian penilaian isi yang biasanya kita lakukan. Kita sebagai warga akan mengatakan bahwa kita tidak perlu menimbang-nimbang dari nol lagi. Tinggal ikuti saja aturan ini sebagai aturan.

Bagaimana ternyata alasan yang diklaim sebagai eksklusif itu dalam kenyataannya kontraproduktif terhadap kehidupan berhukum masyarakat? Siapa yang harus disalahkan? Apakah penguasa yang ada di belakang kebijakan itu dapat menimpakannya ke kecerdasan artifisial?

Teori personifikasi yang berkembang saat ini, baik teori fiksi maupun organ, belum dapat menerima kemungkinan demikian. Teori fiksi dari Friedrich Carl von Savigny hanya memberi kesempatan menjadi subjek hukum ini pada manusia. Di sini Savigny berbicara tentang syarat kepribadian yuridis yang ditautkan ke faktor kehendak. Namun, ia menerima persona ficta, seperti korporasi dan perkumpulan, sebagai subjek hukum. Bukan karena korporasi itu punya kehendak moral sendiri, melainkan karena hukum memperlakukannya seolah-olah satu pribadi demi kebutuhan praktik—dan pada akhirnya tetap bisa ditelusuri ke kehendak manusia (pengurus, anggota, organ dari korporasi itu). Pemikiran ini dikenal dengan teori fiksi.

Teori lain datang dari Otto von Gierke. Ia menentang cara pandang Savigny yang melihat badan hukum terutama sebagai fiksi. Bagi Gierke, subjek hukum selain manusia itu sangat mungkin karena mereka dipandang nyata secara sosial, bukan sekadar rekaan teknis-yuridis. Badan-badan itu nyata-nyata ada dalam kehidupan sosial kita, sehingga seharusnya diposisikan sebagai kepribadian hukum yang nyata (realen Verbandperson). Kelompok itu punya “kehendak kolektif” (Gesamtwille), bukan kehendak mistis, tapi kehendak yang terbentuk lewat proses internal organisasi. Kelompok itu bertindak melalui “organ” (direksi, pengurus, wali kota, pejabat negara, dan sebagainya), yang dilihat sebagai organ dari “pribadi persekutuan” itu. Tindakan organ dianggap tindakan badan itu sendiri, bukan sekadar tindakan wakil yang berdiri di luar.

Di luar itu ada teori yang disampaikan oleh Gunther Teubner. Menurutnya, hukum dapat membuat entitas non-manusia jadi alamat komunikasi, yaitu sebuah alamat yang memungkinkan norma, hak, kewajiban, tanggung jawab, gugatan, sanksi, dan lain-lain, melekat pada sesuatu yang stabil. Ini disebutnya semacam fiksi hukum yang nyata (real legal fiction):, Ia adalah fiksi karena bukan manusia, tetapi ia nyata karena bekerja efektif dan menstrukturkan ekspektasi sosial. Ia adalah sistem organisasi yang mereproduksi dirinya lewat rangkaian komunikasi internal (berupa program, prosedur, audit, kepatuhan, struktur organ) yang membuatnya tampak punya rasionalitas dan kehendak sendiri, bukan lagi sekadar kehendak psikologis, tetapi logika keputusan organisasi.

Nah, apakah suatu kecerdasan artifisial dapat masuk ke dalam denotasi yang disampaikan Savigny, Gierke, dan/atau Teubner? Stefan Koos, dalam buku yang kami sunting bersama, berjudul “Kecerdasan Artifisial dalam Hukum Keperdataan” (2025: 205-208) memberikan pandangannya. Saya ingin mengutip beliau agak panjang penjelasan sebagai berikut:

Pertama-tama perlu ditetapkan bahwa berdasarkan teori fiksi, pengakuan AI sebagai subjek hukum dimungkinkan secara murni pragmatis-fungsional oleh pembuat undang-undang, karena teori fiksi tidak mensyaratkan adanya dasar humanistik, filosofis atau hukum faktual untuk personifikasi. Misalnya, jika pembuat undang-undang setelah melakukan penilaian ekonomi terhadap risiko pertanggungjawaban dari pengoperasian sistem AI otonom menyimpulkan bahwa pengenaan tanggung jawab (tunggal) kepada operator manusia dari sistem tersebut tidak lagi memadai, maka pembuat undang-undang dapat menjadikan sistem AI tertentu sebagai penyandang hak dan kewajiban. Hal ini akan mengakibatkan bahwa risiko-risiko dapat dialokasikan kepada subjek hukum AI tersebut. Personifikasi sebagai badan hukum yang sesungguhnya harus dilakukan secara tegas oleh pembuat undang-undang dan juga akan memerlukan pembentukan publisitas hukum, misalnya melalui suatu register AI. Dari pendekatan pragmatis-fungsional, dapat disimpulkan bahwa hak dan kewajiban hanya akan diberikan kepada subjek hukum AI sejauh hal tersebut diperlukan untuk tujuan personifikasi dan berkaitan dengan integrasi subjek hukum tersebut ke dalam konteks sosial, hukum, dan ekonomi.

Jika probabilitas teori fiksi dapat diterima (dengan catatan diperlukan justifikasi terkait tujuannya secara sosial, hukum, dan ekonomi), maka pemikiran Gierke ternyata juga punya peluang, walaupun lebih kecil dibandingkan dengan teori fiksi. Kesulitan ini, menurut saya, sangat mungkin akan lebih teratasi apabila tahapan perkembangan kecerdasan artifisial telah sampai pada level ASI. Saya ingin mengutip Stefan Koos kembali, sebagai berikut:

Berdasarkan teori teori realitas, personifikasi AI lebih sulit untuk dibenarkan. Di sini perlu dipertanyakan apakah terdapat ‘substrat personifikasi’ yang memadai yang dapat membenarkan penerimaan realitas AI oleh hukum dalam bentuk pengakuan kecakapan hukum. Badan hukum memiliki anggota dan organ yang merupakan pembawa kehendak dari kesatuan itu sendiri. Pada yayasan sebagai badan hukum memang tidak ada anggota, tetapi ada kehendak berkelanjutan dari pendiri yang menjadi dasar tujuan yayasan dan membentuk “kepribadian” yayasan tersebut. Dalam kasus AI, kita tidak menemukan ‘substrat personal’ apa pun: Tidak ada kehendak manusia dari suatu organ, dan bahkan tidak ada kehendak pencipta yang ‘nyata’ dalam sistem AI yang beroperasi secara otonom. Pemrograman algoritma dasar AI tidak dapat dianggap sebagai manifestasi kehendak pencipta manusia, karena personifikasi AI hanya dapat dipertimbangkan jika sistem tersebut memiliki tingkat otonomi yang tinggi terhadap pemrograman manusia. AI itu sendiri bukan entitas personal, tetapi bersifat teknis-algoritmis. Oleh karena itu, sulit untuk berargumen bahwa ada landasan humanis-filosofis yang dapat membenarkan pengakuan AI sebagai subjek hukum. Ini berlaku setidaknya jika personifikasi harus didasarkan pada kesamaan tertentu dengan kehendak dan tindakan manusia, yang harus lebih dari sekadar simulasi perilaku manusia yang lebih atau kurang sempurna, seperti yang terjadi pada AI. Berdasarkan tingkat perkembangan teknologi saat ini, masih lebih dapat dibenarkan bahwa hewan cerdas, seperti simpanse atau lumba-lumba, lebih memungkinkan untuk dipertimbangkan dalam personifikasi hukum

Dalam tulisan saya tentang alam sebagai subjek hukum, saya mengacu ke pemikiran Stevan M. Wise yang mengusulkan agar hewan-hewan berjenis primata diberi peluang menjadi subjek hukum. Kita dapat melihat korelasi pandangan Wise dengan pemikiran Gierke.

Lalu, bagaimana jika kita menyenggol pemikiran Teubner? Stefan Koos menulis sebagai berikut:

Sebaliknya, tidak dapat dikesampingkan bahwa dasar prahukum untuk personifikasi hukum AI tidak harus bergantung pada aspek antropomorfis yang sempit, melainkan cukup bahwa AI merupakan bagian dari sistem komunikasi hibrida dan proses komunikasi yang terkait dengan komunikasi manusia. Meskipun cara kerja AI mungkin tidak identik dengan perilaku manusia (not equivalent to human behavior), melainkan hanya mensimulasikannya (only simulating it), dapat dikemukakan argumen bahwa yang penting bukan cara kerja AI, melainkan bahwa komunikasi berbasis AI setidaknya di masa depan kompatibel dengan komunikasi manusia.

Kita dapat menyimpulkan bahwa dengan dasar pemikiran Teubner, peluang kecerdasan artifisial menjadi lebih besar untuk diberi status subjek hukum. Hanya saja, lagi-lagi kita masih harus menunggu perkembangan di masa depan, seberapa komunikasi berbasis kecerdasan artifisial itu kompatibel dengan komunukasi manusia, dengan segala modalitas yang dimiliki.

Suatu ketika, dalam sebuah diskusi, seorang rekan diskusi menanyakan apabila kecerdasan artifisial saat ini dibandingkan dengan kecerdasan manusia pada usia tertentu, maka di mana posisi kecerdasan artifisial tersebut? Penelitian saat ini memang belum mampu memberi tolok ukur yang seragam. Hal ini karena kecerdasan manusia berkembang secara multi-dimensional, melibatkan kecerdasan bahasa, sosial (interpersonal), motorik (kinestetik), spasial, matematis, musik, natural, refleksi diri (intrapersonal), dan laih-lain, sementara kecerdasan artifisial hari ini menunjukkan ketidakajegan. Ia sangat kuat pada beberapa tes, tetapi justru lemah pada tes lainnya, yang sebenarnya tes itu justru sangat mendasar bagi manusia.

Dalam buku “Human+Machine” karya Paul R. Daugherty dan H. James Wilson (2018) yang telah beberapa kali saya kutip, termasuk dalam orasi saya pada tahun 2022, dinyatakan bahwa ada area aktivitas yang hanya berlaku untuk manusia (human-only activity) mencakup karakteristik yang khas mansuia, yaitu to judge, to create, to emphatize, dan to lead. Area ini relatif masih belum tersentuh oleh teknologi kecerdasan artifisial sampai saat ini. Walaupun buku yang mereka tulis itu ditujukan untuk kalangan pebisnis, saya menilai tetap relavan untuk kita renungkan segala kemungkinan bahwa suatu waktu di masa depan, kecerdasan artifisial mampu menggunakan modalitas yang khas kita, para manusia miliki. Jika momentum itu tiba, status subjek hukum untuk kecerdasan artifisial perlu kita sematkan kepadanya. (***)

Comments :